Независимые случайные величины – это одно из ключевых понятий в теории вероятностей и статистике. Вероятность их возникновения не зависит от друг друга, то есть значения одной случайной величины не влияют на значения другой. Это свойство позволяет более точно моделировать и анализировать случайные процессы и явления, как в естественных науках, так и в экономике или финансах.

К примеру, если случайные величины X и Y независимы, то вероятность того, что событие A произойдет одновременно событиями X и B произойдет одновременно событиями Y, равна произведению вероятностей обоих событий. Это можно выразить формулой P(A∩B) = P(A) · P(B).

Еще одним основным свойством независимых случайных величин является то, что математическое ожидание произведения независимых случайных величин равно произведению их математических ожиданий. Другими словами, если X и Y – независимые случайные величины, то E(XY) = E(X) · E(Y), где E(X) обозначает математическое ожидание случайной величины X.

Изучение и анализ свойств независимых случайных величин позволяет более эффективно моделировать и прогнозировать случайные процессы в различных областях знаний. Определение и понимание этих свойств является важным шагом в изучении уровня вероятности и статистики.

Что такое независимые случайные величины

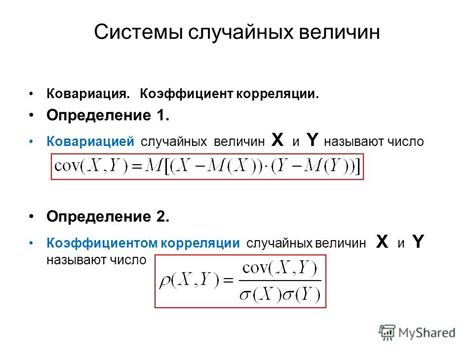

Для формального определения независимости случайных величин используется понятие совместной функции распределения. Если для двух случайных величин X и Y их совместная функция распределения равна произведению их отдельных функций распределения, то говорят, что X и Y являются независимыми. Математически это выглядит следующим образом:

P(X=x, Y=y) = P(X=x) * P(Y=y), где P(X=x, Y=y) - совместная функция распределения для случайных величин X и Y, а P(X=x) и P(Y=y) - их отдельные функции распределения.

Независимые случайные величины играют важную роль в теории вероятностей и статистике, так как позволяют упростить анализ сложных случайных ситуаций и проводить более точные вычисления.

Определение и понятие

Для определения независимости случайных величин используется понятие условной вероятности. Если при условии, что одна случайная величина принимает определенное значение, вероятность другой случайной величины не меняется, то такие величины являются независимыми.

Независимые случайные величины являются важным понятием в теории вероятностей и статистике, так как они позволяют строить модели, которые отражают сложные случайные процессы в реальном мире.

Свойство независимости

Формально, две случайные величины X и Y называются независимыми, если выполняется следующее условие:

P(X=x, Y=y) = P(X=x) \cdot P(Y=y)

где P(X=x, Y=y) – вероятность одновременного наступления событий X=x и Y=y, P(X=x) – вероятность события X=x, P(Y=y) – вероятность события Y=y.

То есть, вероятность наступления двух событий X и Y одновременно равна произведению вероятностей наступления каждого из них по отдельности.

Основное следствие такого определения можно сформулировать следующим образом: сумма или разность независимых случайных величин также являются независимыми случайными величинами.

Свойство независимости является одним из фундаментальных понятий в теории вероятностей и широко используется в математической статистике и других областях науки.

Свойство множественных независимых случайных величин

Множество случайных величин X₁, X₂, ..., Xₙ называется независимым, если для любого набора борелевских множеств A₁, A₂, ..., Aₙ выполняется следующее свойство:

P(X₁ ∈ A₁, X₂ ∈ A₂, ..., Xₙ ∈ Aₙ) = P(X₁ ∈ A₁) * P(X₂ ∈ A₂) * ... * P(Xₙ ∈ Aₙ)

То есть вероятность совместного появления событий для каждой случайной величины равна произведению их вероятностей.

Свойство множественных независимых случайных величин имеет несколько важных следствий:

- Среднее значение суммы независимых случайных величин равно сумме средних значений каждой из них.

- Дисперсия суммы независимых случайных величин равна сумме дисперсий каждой из них.

- Дисперсия разности независимых случайных величин равна сумме их дисперсий.

Свойство независимости случайных величин является одним из основных в теории вероятностей и имеет широкое применение в различных областях, включая статистику, эконометрику и финансовую математику.

Примеры использования

Пример 1:

Рассмотрим ситуацию, когда мы подбрасываем монету два раза. Пусть X - число выпавших орлов, а Y - число выпавших решек. Значения X и Y зависят друг от друга, так как если мы знаем значение одной из них, то можем легко определить значение другой. В данном случае X и Y не являются независимыми случайными величинами.

Пример 2:

Допустим, у нас есть два отдельных события: A - выпадение орла при подбрасывании монеты и B - выпадение шестёрки при бросании кубика. Значения A и B не зависят друг от друга, так как результат бросания монеты никак не влияет на результат бросания кубика и наоборот. Таким образом, A и B являются независимыми случайными величинами.

Пример 3:

Представим, что у нас есть два игральных кубика, и мы бросаем их одновременно. Пусть X - сумма выпавших очков на первом кубике, а Y - сумма выпавших очков на втором кубике. В данном случае X и Y также являются независимыми случайными величинами, так как результат бросания одного кубика не влияет на результат бросания другого кубика.

Таким образом, независимые случайные величины являются важным инструментом в теории вероятностей для анализа и моделирования случайных процессов.