В термодинамике понятие энтропии играет важную роль и позволяет изучать степень неупорядоченности или хаоса системы. Энтропия обычно принимает положительные значения, но в некоторых случаях она может быть равна нулю.

Когда энтропия равна нулю, это означает, что система находится в полном порядке и все ее состояния равновероятны. В таком случае, все частицы системы находятся в одном и том же состоянии, а их движение не вызывает дополнительного разделения энергии.

Однако, на практике система с энтропией ноль является идеализированной и редко встречается в природе. В идеальной кристальной решетке все атомы находятся на своих местах и не имеют никаких дефектов. Такая структура может быть достигнута при абсолютном нуле температуры.

Выводы, которые можно сделать из равенства нулю энтропии, включают описание идеализированных состояний и предлагают методы для измерения степени неупорядоченности системы. Энтропия является важной концепцией не только в физике и химии, но и в биологии и информатике, и понимание ее значения помогает лучше понять различные системы и их поведение.

Энтропия равна нулю и ее значение

Значение энтропии равной нулю важно для понимания систем, где происходят процессы, построенные на базе детерминированных законов. В таких системах существует точная формула или алгоритм для предсказания результатов событий на основе начальных условий.

| Система | Энтропия | Значение |

|---|---|---|

| Кристаллы | 0 | Идеально упорядоченная структура |

| Вычислительные алгоритмы | 0 | Точное предсказание результатов |

Однако, в реальных системах, значение энтропии равной нулю встречается крайне редко. В современном мире большинство систем являются стохастическими, где результаты событий не всегда предсказуемы. Из этого следует, что уровень энтропии обычно больше нуля.

Выводы, которые могут быть сделаны, когда энтропия равна нулю, зависят от контекста. Это может означать, что система находится в состоянии равновесия, где все части системы взаимодействуют в строго заданном порядке. Также это может указывать на то, что система имеет высокую степень организации и структуры.

Однако, в реальном мире энтропия никогда не равна нулю, и поэтому системы всегда подвержены изменениям и эволюции.

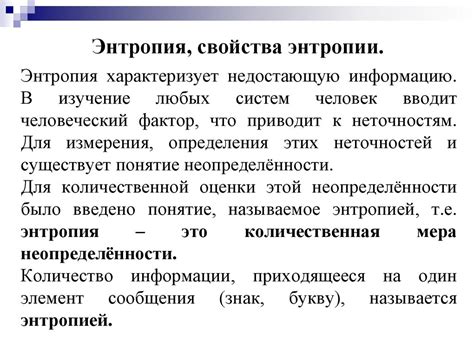

Определение понятия энтропии

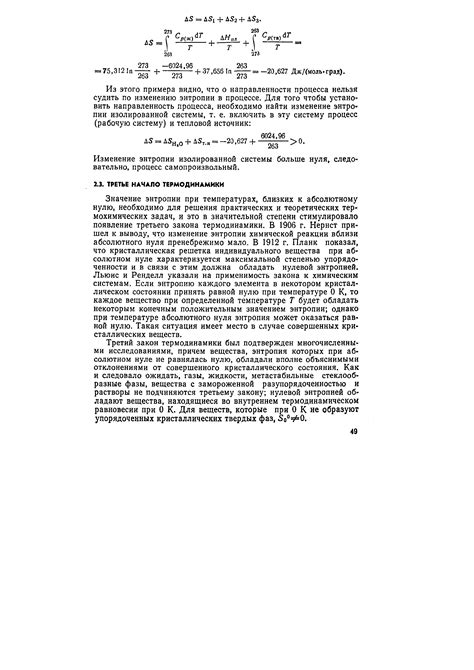

Согласно второму началу термодинамики, энтропия изолированной системы всегда стремится увеличиваться. В состоянии равновесия энтропия достигает максимального значения и равна нулю.

Понятие энтропии широко используется в различных областях науки, включая физику, химию, информатику и теорию вероятности. В физике энтропия является мерой беспорядка или хаоса в системе. В химии энтропия характеризует распределение энергии между молекулами и степень хаоса в химической системе. В информатике энтропия определяет количество информации, которое необходимо для описания состояния системы. В теории вероятности энтропия используется для оценки неопределенности и разнообразия вариантов событий.

Определение понятия энтропии важно для понимания основных законов природы и применения в различных научных и технических областях.

Значение энтропии равной нулю

Однако, в реальном мире энтропия нулевая практически недостижима. Процессы разрушения, внешние воздействия и внутренние флуктуации всегда приводят к некоторому уровню энтропии. Необходимо учитывать, что энтропия равная нулю является идеализированным понятием и служит теоретическим примером для исследования систем и их поведения.

Значение энтропии равное нулю может быть полезным для анализа и моделирования простых и обособленных систем. Оно помогает понять основные законы, причинно-следственные связи и предсказывать будущие состояния системы. Также, энтропия равная нулю может служить идеальным эталоном для сравнения уровня хаоса и стабильности различных систем.

Связь энтропии с вероятностью

Энтропия в теории информации связана с вероятностью и позволяет оценивать степень неопределенности или неожиданности наблюдаемых значений.

Вероятность – это мера того, насколько данное событие может произойти или не произойти. Чем больше вероятность, тем менее неожиданным будет событие, и наоборот.

Энтропия характеризует степень неопределенности системы и может быть применена для оценки вероятности отдельных событий. Если энтропия системы равна нулю, это означает, что система находится в состоянии абсолютной определенности, то есть все возможные состояния системы имеют нулевую вероятность.

В случае, если энтропия системы равна нулю, нет нужды в передаче информации, так как все возможные состояния уже известны. Это означает, что система находится в полностью упорядоченном состоянии, где каждое событие имеет вероятность 1. Например, если на игральной кости находится только одна грань с числом 6, то энтропия такой системы будет равна нулю, так как вероятность получить число 6 равна 1.

Основываясь на значении энтропии, можно сделать выводы о степени упорядоченности и предсказуемости системы. Низкая энтропия указывает на высокую степень определенности, тогда как высокая энтропия свидетельствует о большей степени неопределенности и разнообразии.

Выводы из энтропии равной нулю

Когда энтропия системы равна нулю, это означает, что система находится в состоянии полного порядка и стабильности. В данном случае, степень неопределенности системы минимальна, и мы можем с большой уверенностью предсказать ее состояние и поведение.

Из энтропии равной нулю можно сделать следующие выводы:

- Система находится в состоянии равновесия: При энтропии равной нулю система достигла состояния максимальной упорядоченности, что означает, что все части системы находятся в стабильном и равновесном положении.

- Отсутствие потери энергии: При отсутствии неопределенности и хаоса система не теряет энергию на перемещение или взаимодействия частей системы. Энергия сохраняется и используется эффективно в системе.

- Система плотно упакована: В состоянии нулевой энтропии, все элементы системы расположены в определенном порядке и очень близко друг к другу. Это говорит о плотной упаковке элементов и минимальном пространстве между ними.

- Высокая организация и информационная структура: Энтропия равная нулю говорит о высокой степени организации системы и наличии четкой информационной структуры. Все части системы взаимодействуют в соответствии с жесткими правилами, что позволяет ей функционировать эффективно и успешно.

Выводы из энтропии равной нулю дают нам понимание о том, как системы могут достичь стабильности и порядка. Эти выводы имеют значение не только в физике и химии, но и в других областях, таких как биология, информационные технологии и управление.

Влияние на информационные системы

Равенство нулю энтропии в информационных системах имеет важные последствия для их функционирования и обработки информации.

Во-первых, когда энтропия равна нулю, это означает, что система находится в состоянии полного порядка и упорядоченности. В такой системе каждый символ или бит информации имеет четкое и предсказуемое значение. Это позволяет системе эффективно функционировать, обеспечивая точность и надежность обработки информации.

Во-вторых, отсутствие энтропии в информационных системах означает отсутствие случайности и неопределенности. В таких системах нет непредсказуемых событий или шума, что позволяет эффективно передавать и сохранять информацию без потерь или искажений.

Однако равенство нулю энтропии также может иметь и негативные последствия для информационных систем. Возможное следствие - чрезмерное детерминирование. Если система полностью упорядочена и все символы или биты информации имеют одинаковые значения, это может привести к потере разнообразия и гибкости в обработке информации. В таких системах может отсутствовать способность адаптироваться к новым условиям или изменять свое поведение в зависимости от контекста.

Таким образом, равенство нулю энтропии в информационных системах означает, что система находится в упорядоченном состоянии, где каждая единица информации имеет предсказуемое значение. Это позволяет обеспечить точность и надежность в обработке информации, но также может ограничить гибкость и способность системы к адаптации.

Применение в криптографии и стеганографии

Энтропия равная нулю имеет важное применение в области криптографии и стеганографии. Это связано с тем, что отсутствие энтропии означает полную предсказуемость и отсутствие случайности.

В криптографии энтропия равная нулю означает, что данное сообщение является идеально зашифрованным и не содержит никаких информационных долей, которые могли бы было использованы для расшифровки. Таким образом, энтропия равная нулю используется для оценки характеристик надежности криптографических систем и алгоритмов.

В стеганографии энтропия равная нулю применяется в решении проблемы обнаружения скрытой информации в цифровых медиа-файлах, таких как изображения, аудио и видео. Если энтропия в таком файле равна нулю, это означает, что файл содержит скрытую информацию, поскольку идеальное изображение или аудиозапись не должны иметь нулевого значения энтропии. Энтропия равная нулю позволяет обнаружить наличие скрытой информации и использовать соответствующие методы извлечения для ее раскрытия.

Таким образом, энтропия равная нулю играет важную роль в области криптографии и стеганографии, обеспечивая надежность и безопасность информационных систем и методов передачи данных.

Практические примеры и реализации

Энтропия равная нулю означает полную предсказуемость и отсутствие неопределённости. В таком случае, система обладает минимальной информацией и можно точно предсказать будущие состояния системы.

Ниже приведены некоторые практические примеры и реализации, где энтропия может быть равна нулю:

- Кристаллическая структура: в кристалле атомы упорядочены в регулярной решётке, что означает, что их положение можно точно предсказать. Такая система будет иметь энтропию равную нулю.

- Пределы состояний: если система ограничена определенным диапазоном состояний, то энтропия может быть равна нулю. Например, у нас есть монета, которая всегда выпадает либо орлом, либо решкой. В этом случае, энтропия системы будет равна нулю, так как нам известно, что система может принимать только два определенных состояния.

В реальном мире энтропия равная нулю очень редко встречается, так как большинство систем подвержены воздействию внешних факторов, что приводит к увеличению неопределенности. Однако понимание энтропии и ее роли позволяет нам лучше изучать различные системы и предсказывать их поведение.